Tag: Eliezer Yudkowsky

Tag: Eliezer Yudkowsky

-

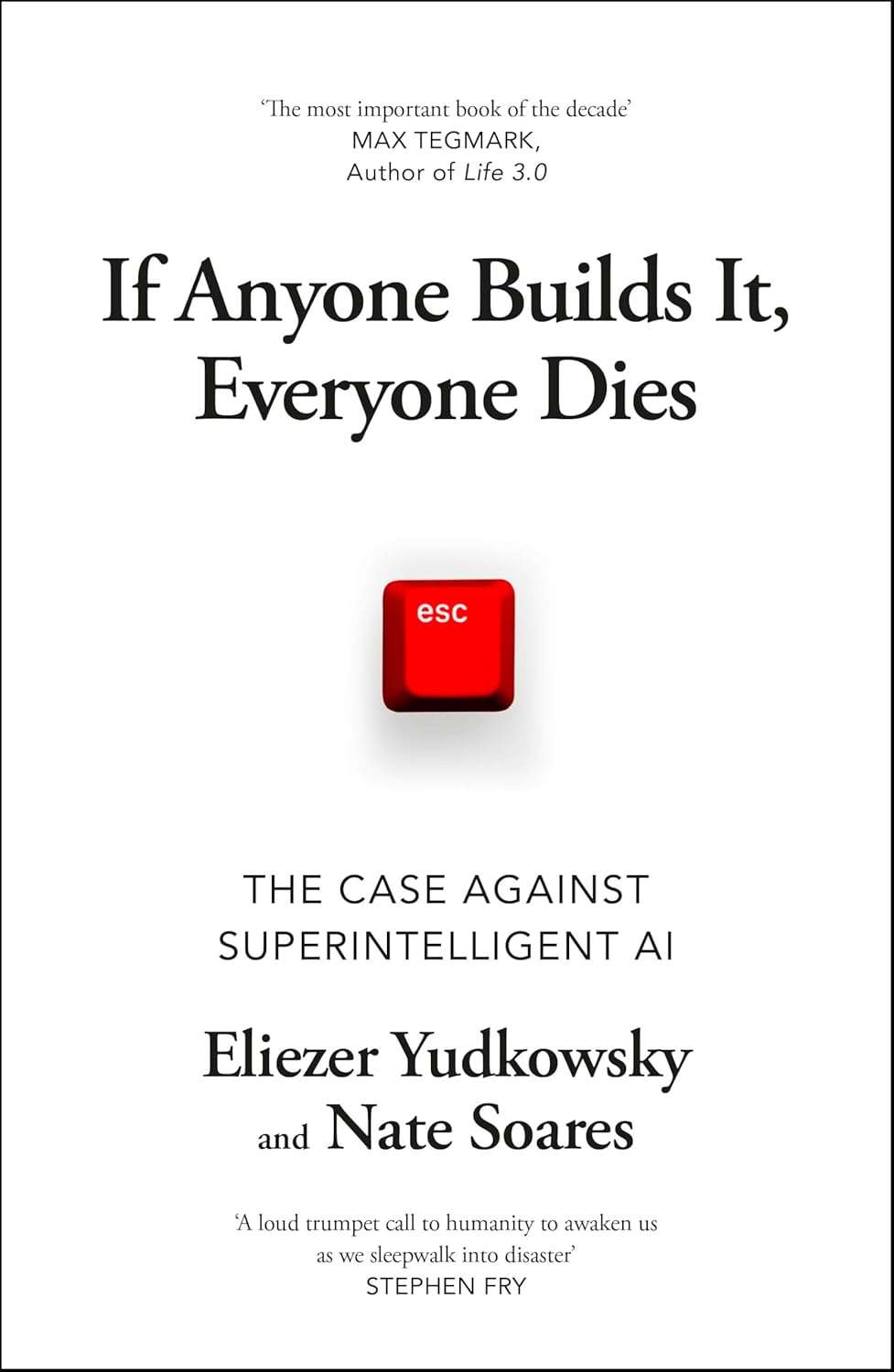

If Anyone Builds it, Everyone Dies

The Case Against Superintelligent AI Secondo Eliezer Yudkowsky e Nate Soares, l’intelligenza artificiale rappresenta la più grande minaccia esistenziale che l’umanità abbia mai affrontato. La corsa globale verso la creazione di un’IA superumana ci sta conducendo verso l’estinzione — ma, avvertono i due studiosi, non è ancora troppo tardi per fermarsi. In questo libro, Yudkowsky e Soares spiegano perché una…

-

Superintelligenza artificiale: il monito di Yudkowsky e Soares

Yudkowsky e Soares nel loro ultimo libro sostengono come l'IA superintelligente porterà all'estinzione umana per diverse ragioni. Leggi qui...

-

La lotta dei Doomers dell’IA

Il movimento dei “Doomers” dell’IA, inizialmente una piccola comunità di esperti preoccupati per i rischi esistenziali legati all’IA, ha guadagnato visibilità e rilevanza con l’uscita di ChatGPT nel 2022, attirando attenzione mediatica e politica. Tuttavia, l’interesse del pubblico e lo slancio regolatorio si sono rapidamente affievoliti, con il Congresso americano che ha rallentato le iniziative…