Tag: Transformer

Tag: Transformer

-

IA generativa e affidabilità delle risposte: soluzioni e criticità attuali

Tecniche come la RAG e il fact-checking cercano di arginare il problema delle alliucinazioni AI, ma eliminarlo del tutto resta impossibile.

-

Titans: architettura AI di Google che supera i limiti Transformer

Google presenta Titans, una nuova architettura che integra memoria neurale avanzata per elaborare sequenze oltre i 2 milioni di token.

-

Transformers all’Avanguardia: La Chiave del Ragionamento Implicito

Nel mondo dell’intelligenza artificiale, una nuova ricerca promette di rivoluzionare il modo in cui i modelli di linguaggio gestiscono il ragionamento complesso. Un team di ricercatori, guidato da Boshi Wang e Xiang Yue, ha pubblicato uno studio innovativo che esplora le capacità dei transformers di apprendere e ragionare implicitamente su conoscenze parametriche. Questo studio, intitolato…

-

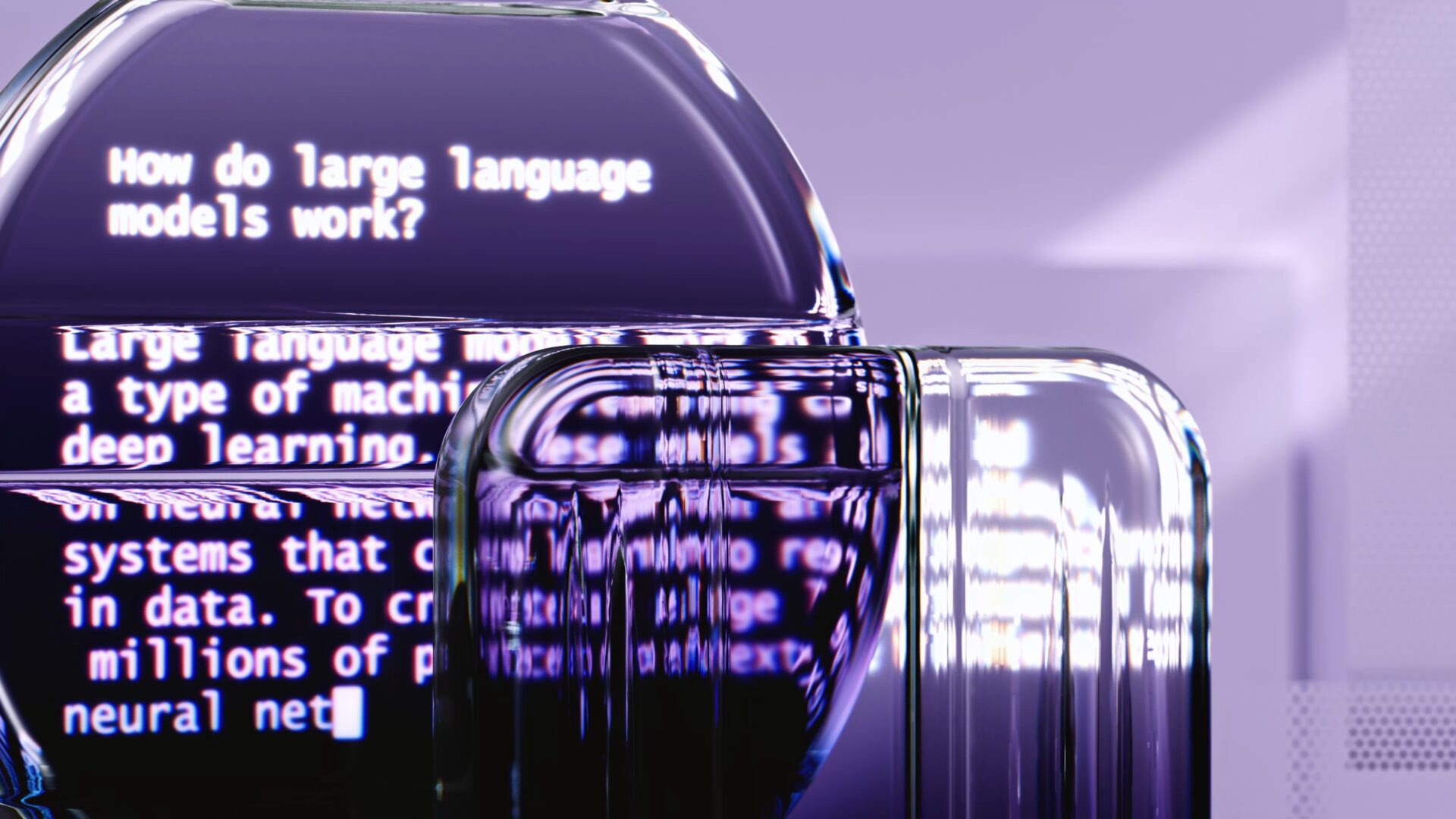

HyperAttention: calcolo dell’attenzione quasi lineare

I modelli di linguaggio basati su Transformer hanno raggiunto enormi successi in applicazioni come l’elaborazione del linguaggio naturale, la visione artificiale e le previsioni di serie temporali. Tuttavia, il loro principale punto debole è la complessità computazionale quadratica degli strati di attenzione rispetto alla lunghezza del contesto di input. Questo ostacolo ha limitato l’applicabilità di…

-

La rivoluzione dell’IA generativa: transformer

Negli ultimi anni, abbiamo fatto un enorme passo avanti nella nostra ricerca decennale per costruire macchine intelligenti grazie all’avvento dei grandi modelli di linguaggio, noti come Large Language Models (LLM). Questa tecnologia, basata sulla modellazione del cervello umano, ha dato vita a un nuovo campo chiamato generative AI, che può creare testi, immagini e codice…